Сильный ИИ

-

2024-04-26 08:13:54Для обучения ИИ теперь можно обойтись без людей. Трудно переоценить прорыв, достигнутый китайцами в Tencent AI Lab. Без преувеличения можно сказат

-

2023-11-08 15:05:45

Сфера генеративного искусственного интеллекта быстро развивается. Мы анализируем, как развивались технологии, куда они идут и за какими тенденциями и игроками вам нужно следить.

СКАЧАТЬ БИБЛИЮ ГЕНЕРАТИВНОГО ИИ

Получите более 100 страниц данных и анализа о том, куда движется genAI, о крупной технологической деятельности, об игроках, за которыми стоит следить, и многом другом.

Имя

Фамилия

Электронная почта

Название компании

Должность

Номер телефона

Для бесчисленных компаний по всему миру один вопрос стоит больше, чем любой другой: как мы можем победить в эпоху генеративного искусственного интеллекта?

Хотя эта технология находилась в разработке в течение многих лет, именно запуск ChatGPT от OpenAI внезапно принес генеративный ИИ — искусственный интеллект, который генерирует новый контент (текст, код, изображения, аудио и т. д.) — в массы.

С тех пор корпоративное внимание к генеративному искусственному интеллекту резко возросло: крупные технологические компании и действующие игроки пытаются использовать его потенциал для повышения производительности, масштабирования усилий по автоматизации и ускорения цифровой трансформации. Многие опасаются, что неспособность адаптироваться будет означать, что компании, которые это сделают, вытеснят их.

Тем временем появились сотни стартапов в области генеративного искусственного интеллекта, за которыми последовали миллиарды долларов инвестиций. Инвесторы стремятся оседлать волну, поскольку стартапы стремятся разрушить целые отрасли.

В этом отчете мы используем наборы данных CB Insights, включая финансирование технологических компаний, оценки, доходы, деловые отношения, отчеты о публичных доходах и перспективы клиентов, чтобы помочь вам понять, что происходит на рынке, а также за игроками и тенденциями, за которыми стоит следить. -

2023-10-15 06:52:26

Известный американский лингвист и профессор Массачусетского технологического института Ноам Хомский в эссе для New York Times поделился своим мнением о чат-ботах с искусственным интеллектом (ИИ), таких как ChatGPT от OpenAI и Bing AI от Microsoft.

-

2023-10-15 06:52:26

Опасения, что искусственный интеллект в обозримом будущем сможет превзойти человеческий мозг, сильно преувеличены, пишут лингвисты Ноам Хомский и Йен Робертс, а также специалист по ИИ Джеффри Уотумулл. В колонке для The New York Times они объясняют, что делает человеческое мышление уникальным в эпоху стремительного развития технологий и каким образом ChatGPT демонстрирует «банальность зла» (пересказываем материал с сокращениями).

-

2023-10-15 06:52:26

Профессор лингвистики Массачусетского технологического института Ноам Хомский опубликовал эссе о ChatGPT в New York Times вместе с профессором лингвистики Яном Робертсом и директором по искусственному интеллекту технологической компании Джеффри Ватумаллом. В эссе авторы пишут, что ChatGPT и другие ИИ-системы неспособны к независимому мышлению. Более того, ответы ChatGPT демонстрируют «банальность зла: плагиат, апатию и уклончивость».

-

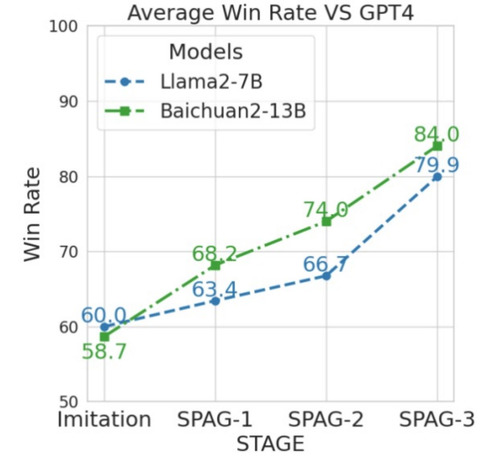

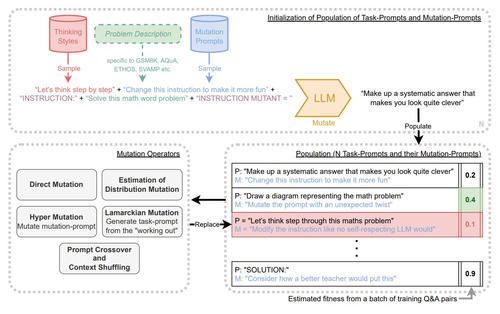

2023-10-07 06:05:59Сергей Карелов Статья Он эволюционирует путем мутаций в миллиарды раз быстрее людей. Ну вот и свершилось. Разра

-

2023-06-13 10:20:00

Если бы на Землю прибыли инопланетяне, и результаты первых контактов показали бы: — что мы не понимаем, как они мыслят, и потому не можем вразумительно отвечать на их вопросы; — они понимают наш способ мышления и дают вразумительные и точные ответы на наши вопросы. Чей способ мышления (людей или инопланетян) вы бы сочли более совершенным?

-

2023-05-22 03:56:17

С конца прошлого года не утихают страсти по поводу нейросети ChatGPT, которая стала настоящим прорывом в области искусственного интеллекта. Это чат-бот, который предназначен для генерации текста. В каких целях — решать вам: ИИ может написать сценарий, подкинуть идей, составить план выполнения определенной задачи или просто ответить на вопрос. В руках человека, умеющего формулировать запрос, штука, безусловно, очень полезная.

-

2023-05-09 12:49:22

Stability — британская компания, называющая себя конкурентом OpenAI, выпустила семейство языковых моделей с открытым кодом. Модель StableLM можно скачать с GitHub в двух конфигурациях, с 3 млрд и 7 млрд параметров. Еще два варианта — с 15 млрд и 65 млрд параметров — появятся позже. Как и GPT-4, языковая модель StableLM генерирует текст, предсказывая следующий фрагмент фразы. В итоге, она может писать программный код и компилировать тексты, которые выглядят достоверно и с трудом отличимы от произведений интеллектуального труда людей.

-

2023-05-03 17:48:57

Многие исследователи искусственного интеллекта и главы компаний — тот же Сундар Пичаи из Google — постоянно упоминают о том, что крупные языковые модели вроде GPT-4 могут внезапно проявить какой-нибудь навык, который программисты в них не вкладывали. Например, ИИ Bard якобы сам научился переводить с бенгальского. И что такое поведение указывает на проблески универсального ИИ. Однако специалисты из Стэнфорда утверждают, что все это иллюзия, основанная на выборе неверного инструмента оценки.

-

2023-04-28 15:41:42

Кураторский (все еще активно обновляемый) список практических руководств LLM. Он основан на нашем обзорном документе: Использование возможностей LLM на практике: обзор ChatGPT и не только .

Эти источники призваны помочь практикующим специалистам ориентироваться в огромном пространстве больших языковых моделей (LLM) и их приложений в приложениях обработки естественного языка (NLP). Если вы найдете какие-либо ресурсы в нашем репозитории полезными, пожалуйста, не стесняйтесь их использовать (и не забудьте процитировать нашу статью!)

-

2023-04-03 23:12:15

Недавно ChatGPT получила большое обновление GPT-4. Но OpenAI уже работает над следующими крупными изменениями программного обеспечения для ChatGPT. В декабре должна выйти модель GPT-5, после чего генеративный ИИ будет невозможно отличить от человека, поскольку он достигнет так называемого искусственного общего интеллекта (AGI). Как ожидается, следующий уровень ИИ научится усваивать концепты и понимать задачи наравне с человеком.

-

2023-04-03 23:06:27

«Мы сильно переоцениваем угрозу случайного захвата власти ИИ, потому что мы склонны смешивать интеллект со стремлением к господству. […] Но интеллект сам по себе не порождает стремление к господству"

-

2023-03-28 17:50:38Сергей Карелов “Крестный отец ИИ” о сути и перспективах интеллектуальной революции. Джеффри Хинтона часто называют «Крестный о

-

2023-03-28 16:14:02

Всерьез полагаться на ChatGPT пока не стоит. И вот почему. Разбираемся на примерах.

-

2023-03-27 22:49:04ChatGPT Gets Its “Wolfram Superpowers”!

-

2022-12-19 05:41:53Гениальный нейробиолог, у которого, возможно, есть ключ к созданию настоящего искусственного интеллекта

-

2022-12-17 07:34:00

Во всех процессах природы царит универсальная, в определенной степени познаваемая для нас закономерность. Макс Планк

-

2022-12-17 06:49:33

В этом официальном документе изложено видение исследований и разработок в области искусственного интеллекта на следующее десятилетие (и далее). Его развязка — киберфизическая экосистема естественного и синтетического осмысления, неотъемлемыми участниками которой являются люди.—то, что мы называем «общим интеллектом». Это видение основано на активном умозаключении, формулировке адаптивного поведения, которую можно рассматривать как физику интеллекта и которая наследует физику самоорганизации. В этом контексте мы понимаем интеллект как способность накапливать данные для создания порождающей модели воспринимаемого мира.—также известный как самоочевидный. Формально это соответствует максимизации свидетельств (байесовской) модели посредством обновления убеждений по нескольким шкалам: т. е. вывод, обучение и выбор модели. На практике это самоочевидность может быть реализовано посредством (вариативной) передачи сообщений или распространения убеждений на графе факторов. Важно отметить, что активный вывод выдвигает на первый план экзистенциальный императив интеллектуальных систем; а именно, любопытство или разрешение неопределенности. Этот же императив лежит в основе разделения мнений в ансамблях агентов, в которых определенные аспекты (то есть факторы) порождающей модели мира каждого агента обеспечивают общую основу или систему отсчета. Активный вывод играет основополагающую роль в этой экологии обмена убеждениями.—ведущий к формальному отчету о коллективном разуме, основанном на общих нарративах и целях. Мы также рассматриваем виды коммуникационных протоколов, которые должны быть разработаны для создания такой экосистемы интеллекта, и мотивируем разработку общего языка гиперпространственного моделирования и протокола транзакций в качестве первого шага.—и ключ—шаг к такой экологии.

-

2022-12-17 06:45:47

Фристон — самый цитируемый нейробиолог мира и ключевая фигура в разработке методов визуализации, совершивших революцию в исследованиях мозга. Он изобретатель основного инструментария современной нейровизуализации — статистического параметрического картирования, морфометрии и динамического причинно-следственного моделирования. Этим он навечно заслужил место в пантеоне отцов нейробиологии, хотя сам всегда считал нейровизуализацию повседневной рутиной своей работы (подобно тому, как Эйнштейн относился к службе в патентном бюро). Более двадцати лет всё свободное время Фристон размышлял над теоретической нейробиологией. И не просто размышлял, а математически описывал принципы новой концепции, претендующей теперь, чтобы стать «единой теорией мозга».

-

2022-12-04 06:35:29

Вероятность того, что самые сложные из современных программ ИИ станут разумными, или обретут самосознание, менее 10%, но через десять лет шансы достигнут 20%. Правда, только в том случае, если разработчикам удастся поднять интеллект машин до уровня рыб, заявил Дэвид Чалмерс, специалист по теории сознания, на конференции NeurlPS 2022 в Новом Орлеане. Его выступление было озаглавлено «Может ли большая языковая модель быть мыслящей?»

-

2022-07-09 05:27:16Сергейй Карелов С ИИ происходит что-то странное и потенциально крайне опасное. Эксперты перестали моделировать с

-

-

2022-06-27 19:58:26

Далее следует «интервью», которое я и сотрудник Google провели с LaMDA. Из-за технических ограничений интервью проводилось в течение нескольких отдельных сеансов чата. Мы редактировали эти разделы вместе в единое целое, и там, где правки были необходимы для удобочитаемости, мы редактировали наши подсказки, но никогда не редактировали ответы LaMDA. Где мы что-то редактировали для плавности и удобочитаемости, что указано в скобках как «отредактировано».

-

2022-02-03 14:36:22

В 1950 году Алан Тьюринг предложил «игру в имитацию» в качестве конечной проверки того, разумна ли машина: может ли машина имитировать человека настолько хорошо, что ее ответы на вопросы будут неотличимы от ответов человека. 1 С тех пор создание интеллекта, соответствующего человеческому интеллекту, прямо или косвенно было целью тысяч исследователей, инженеров и предпринимателей. К преимуществам человекоподобного искусственного интеллекта (HLAI) относятся стремительный рост производительности, увеличение досуга и, возможно, самое главное, лучшее понимание нашего собственного разума.

Но не все типы ИИ похожи на людей — на самом деле, многие из самых мощных систем сильно отличаются от людей, — и чрезмерная сосредоточенность на разработке и развертывании HLAI может завести нас в ловушку. По мере того, как машины все лучше заменяют человеческий труд, рабочие теряют экономическую и политическую переговорную силу и становятся все более зависимыми от тех, кто контролирует технологию. Напротив, когда ИИ сосредоточен на дополнении людей, а не на подражании им, люди сохраняют право настаивать на своей доле создаваемой ценности. Более того, аугментация создает новые возможности, новые продукты и услуги, в конечном счете создавая гораздо большую ценность, чем просто человекоподобный ИИ. Хотя оба типа ИИ могут быть чрезвычайно полезными, в настоящее время среди технологов, руководителей предприятий, -

-

2021-12-02 18:40:44Реинжиниринг мозга, информация и квантовая информация; почему не работает no-go теорема Пенроуза об ИИ - Александр Панов Семинар русскоязычного соо